03. Juli 2024

KI-Ausblick in die nächsten 10 Jahre mit Alois Krtil, CEO von ARIC

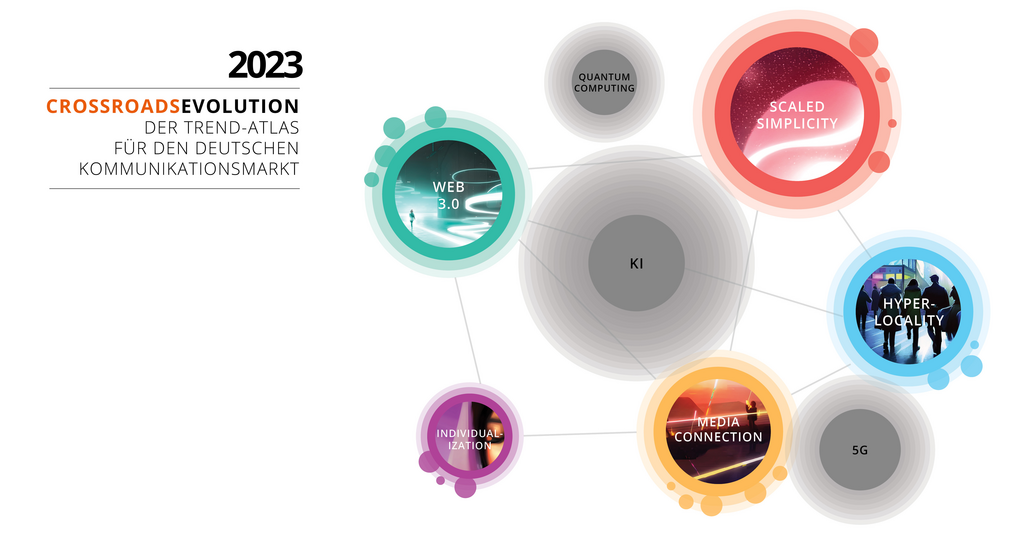

Vor kurzem haben wir unser Crossroads Essay „The Future of AI“ veröffentlicht. Was wir über KI wissen und welche Auswirkungen sie in den nächsten 10 Jahren auf den deutschen Medien- und Kommunikationsmarkt haben wird. Mit unserer begleitenden Blogserie möchten wir euch vertiefende Insights externer Expert:innen an die Hand geben und die Serie mit einem Beitrag von Alois Krtil (Gründer und CEO des Artificial Intelligence Center Hamburg) fortsetzen.

Alois Krtil ist der Gründer und CEO des Artificial Intelligence Center Hamburg (ARIC). Unter seiner Führung hat sich ARIC zu einer Schlüsselinstitution entwickelt, die über 650 Industriemitglieder, 200 Wissenschaftler und 100 internationale Kooperationspartner vereint. ARIC spielt eine wichtige Rolle in der Förderung und Anwendung von KI in verschiedenen Sektoren, von Start-ups über kleine bis mittelständische Unternehmen (KMU) bis hin zu Konzernen in der Metropolregion Hamburg. Alois ist auch als Technologie- und KI-Experte aktiv, berät die deutsche Bundesregierung, sitzt im Beirat für Quantencomputing des DLR, ist CTO bei Pinktum und in verschiedenen Ausschüssen und Gremien tätig.

Was ist aus Deiner Sicht der aktuelle Status quo von Generativer KI und warum?

Auf einer Skala von 1 – 100 sind wir ungefähr bei einer 30 angekommen – wir stehen also noch recht am Anfang der Entwicklung. Wir werden in diesem Jahr noch sehr viele Fortschritte hinsichtlich der Qualität der verschiedenen Modelle und Ansätze erleben. Sora, die Text to Video Anwendung von OpenAI, beispielsweise ist im April eingeschlagen und wird mit Hochdruck weiterentwickelt.

Grundsätzlich ist das Thema Text to Video bereits einige Monate alt und wir sagen hier bewusst „alt“, denn ich sehe hier eine ähnliche Entwicklung wie bei den anfänglichen Text to Image Modellen, wie Midjourney & Co: Zu Beginn gab es noch viele Darstellungsfehler in den Diffusionsmodellen, die dann aber in sehr kurzen Abständen sehr viel besser wurden. Generative KI steckt noch im Kindesalter und aktuell wird intensiv an der Qualitätssteigerung, Robustheit und Governance der multimodalen Modelle gearbeitet.

In Bezug auf die Adoption und Annahme des Menschen muss berücksichtigt werden, dass Technologieentwicklung in Sättigungsgraden verläuft. Wir werden uns immer schneller an die Sprünge in der Entwicklung gewöhnen und an neue Technologien anpassen.

Welche Grenzen hat Generative KI? Was wäre für Dich eine 100 % ausentwickelte Form?

Generative KI hat verschiedene Grenzen, darunter technische, ethische und regulatorische. Technisch gesehen sind Generative KI-Modelle immer noch begrenzt durch ihre Trainingsdaten und die zugrunde liegenden Algorithmen. Es gibt daher Schwierigkeiten, komplexe menschliche Emotionen oder kulturelle Nuancen genau zu erfassen. Ethische Grenzen beziehen sich auf Fragen der Privatsphäre, Bias und Verantwortlichkeit. In einer 100 % ausentwickelten Form könnte Generative KI in der Lage sein, komplexe menschliche Interaktionen und Bedürfnisse mit großer Präzision zu verstehen und darauf zu reagieren, während sie gleichzeitig ethische Grundsätze und Datenschutzrichtlinien respektiert. Sie würde auch in der Lage sein, sich kontinuierlich selbst zu verbessern, um mit den sich ständig ändernden menschlichen Dynamiken Schritt zu halten.

Die Grenze wird häufig auch im Vergleich zu menschlichen Fähigkeiten gezogen. Generative KI kann bereits hochqualitative Ergebnisse in den Bereichen Musik, Video, Bild und Text generieren. In vielen Fällen, vor allen Dingen bei Text- und Bild-Anwendungen ist die Qualität bereits so ausgereift, dass sie das Niveau von menschlichen Expert:innen erreicht haben. In den nächsten 12 bis 24 Monaten wird es in diesem Bereich zu weiteren Sprüngen aber auch neuen Ansätzen kommen, so wie aktuell durch die Veröffentlichung von ChatGPT-4o. Eine 100 % ausentwickelte Form von generativer KI wäre für mich eine, bei der die menschliche Kreativität und Schöpfungskraft in allen Bereichen erreicht oder sogar übertroffen wird. Wenn man nicht mehr unterscheiden kann, ob ein Werk (egal ob Text, Video oder Musik) von Mensch oder Maschine stammt.

Wird der EU AI Act signifikante Auswirkungen auf die Entwicklung von Generativer KI-Anwendungen in Deutschland haben?

Regulierungen sind nicht per se schlecht. Sie sollten allerdings gut gemacht sein, um Innovationen nicht zu bremsen. Notwendige Leitplanken, ähnlich wie Verkehrsregeln, sind sinnvoll. Der EU AI Act könnte definitiv signifikante Auswirkungen auf die Entwicklung von Generative KI-Anwendungen in Deutschland haben. Der Akt zielt darauf ab, eine kohärente und verantwortungsbewusste Regulierung von KI-Technologien in der Europäischen Union sicherzustellen. Dies könnte sowohl positive als auch negative Auswirkungen haben, je nachdem, wie die Regeln formuliert sind und wie sie von den Unternehmen und Forschungseinrichtungen in der Praxis umgesetzt werden müssen. Doch wenn Regulierung als Innovationsbremse wirkt, dann ist sie nicht gut gemacht.

Im Hinblick auf Wahlen und Wahlbeeinflussung durch KI-Bots sind Leitplanken sehr wichtig. Natürlich muss die Regulatorik dahinter stimmen. Das heißt die Regulatorik darf nicht so ausgestaltet sein, dass sie kleinere Unternehmen benachteiligt oder sie in der Praxis nicht anwendbar sind. Wenn Europa es richtig macht, könnte es ein Vorbild für die Welt werden. Wir sind nicht die einzigen, die KI regulieren. Auch in Kanada, USA und Asien gibt es ähnliche Bewegungen. Eine gut umgesetzte Regulierung könnte sogar als Gütesiegel betrachtet werden.

Was wäre Dein persönlicher Wunsch oder Deine ideale Welt und welche Rolle spielt darin Generative KI?

Kurz- und mittelfristig stelle ich mir eine Welt vor, in der viele KI-Tools und -Systeme den Menschen als Co-Piloten unterstützen. Sie sind tief in unserem Alltag integriert, nehmen uns Aufgaben ab und machen uns so effizienter und schneller. Langfristig wäre die ideale Welt eine, in der uns KI-Anwendungen von mühsamen Routineaufgaben befreien und uns dabei unterstützen, komplexe Probleme effizient zu lösen. Gleichzeitig bleiben Menschen die letztendlichen Entscheidungsträger und Kuratoren der von KI generierten Inhalte und Ideen.